Punti chiave

- L’UE presenta il Codice Etico sull’IA per le scuole: Le nuove linee guida richiedono un uso trasparente, equo e psicologicamente sicuro degli strumenti di IA nei sistemi educativi europei.

- Focus su benessere e autonomia degli studenti: I responsabili politici puntano a proteggere salute mentale, privacy e capacità decisionale degli studenti, in risposta alle crescenti preoccupazioni su sorveglianza algoritmica e bias.

- Collaborazione tra aziende tech e insegnanti: Grandi imprese europee della tecnologia, educatori e rappresentanti degli studenti hanno contribuito alla definizione di principi che superano la semplice compliance, promuovendo pensiero critico e competenze digitali.

- IA come compagno, non supervisore: Il codice esclude sistemi che sostituiscano l’esperienza umana fondamentale, incentivando la tecnologia come mentore nell’esplorazione creativa e intellettuale, non come disciplinatore o autorità di rimpiazzo.

- Modello per standard globali: I leader UE propongono il codice come base per una futura adozione internazionale, invitando altre regioni a partecipare al dialogo sul valore etico dell’IA nell’istruzione.

- Prossimi passi: progetti pilota e feedback: Gli Stati membri testeranno le linee guida in alcune scuole a partire da questo autunno, con revisioni pubbliche e feedback guidato dagli studenti prima dell’attuazione su scala continentale.

Introduzione

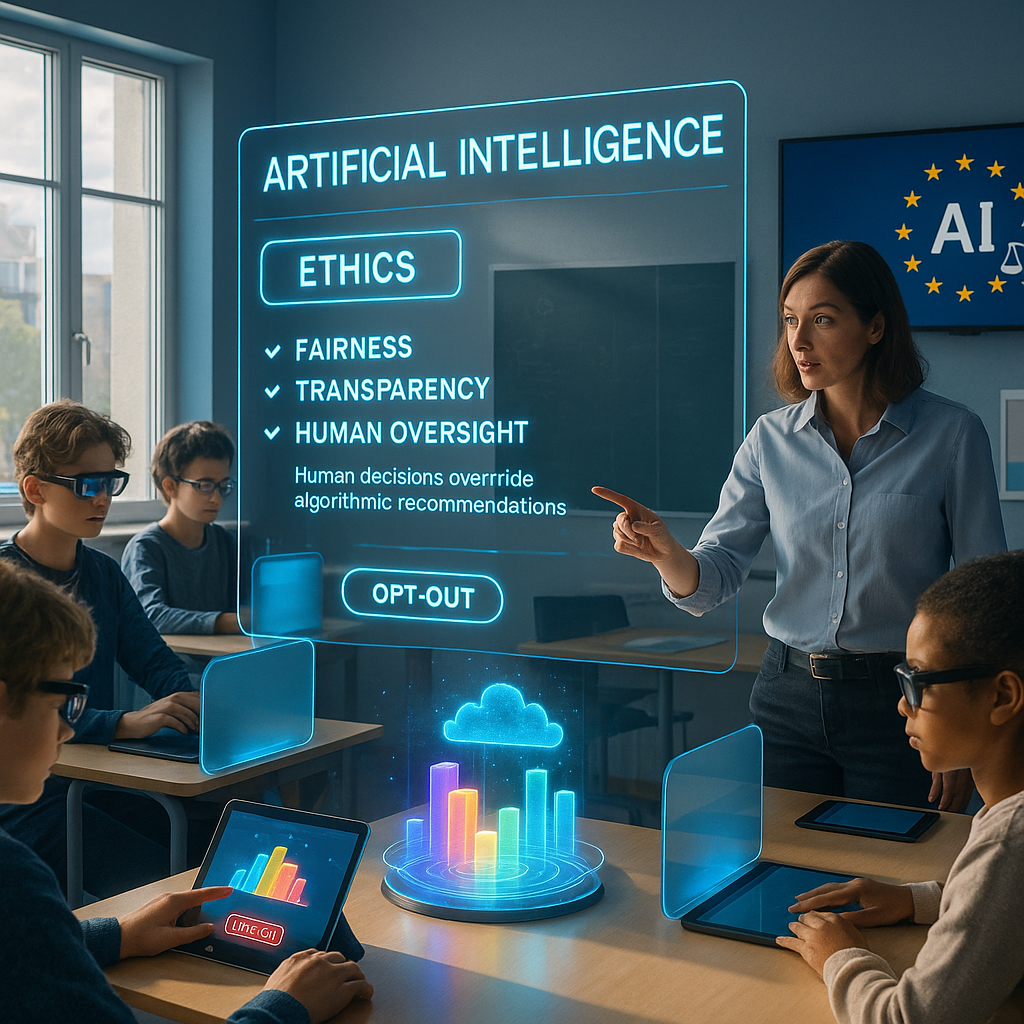

I principali responsabili della politica tecnologica europea hanno presentato oggi a Bruxelles un innovativo codice etico sull’IA dedicato alle scuole. L’obiettivo è mettere benessere e autonomia degli studenti al centro di un’istruzione sempre più influenzata dagli algoritmi. Sviluppato insieme a industria, insegnanti e studenti, il codice stabilisce standard trasparenti e psicologicamente sicuri per l’uso dell’IA nelle classi europee. In questo senso, l’UE si pone come modello di riferimento per un apprendimento etico e centrato sull’umano nell’era delle “menti aliene”.

Il nuovo codice etico sull’IA: cosa cambia nelle scuole europee

I responsabili dell’istruzione europea hanno definito linee guida rigorose che impongono agli strumenti di IA di fornire spiegazioni trasparenti sui processi decisionali adottati negli ambienti educativi. Il quadro normativo, ratificato dal Consiglio europeo dell’istruzione, obbliga le IA a comunicare chiaramente come valutano gli elaborati degli studenti e forniscono raccomandazioni.

Il codice stabilisce limiti precisi sul ruolo dell’IA nelle valutazioni, garantendo che la decisione finale su voti ed esiti resti sempre agli insegnanti.

“Stiamo facendo in modo che la tecnologia sia un supplemento, non un sostituto, del giudizio umano nell’istruzione”,

ha dichiarato Maria Kowalski, responsabile della Task Force europea per l’IA nell’istruzione.

La tutela dei dati degli studenti è uno dei cardini delle nuove regole, con limiti rigorosi sulla raccolta e l’uso delle informazioni personali da parte delle IA. Le scuole dovranno raccogliere un consenso esplicito per le analisi basate su IA e offrire meccanismi chiari di opt-out per studenti e famiglie.

Stay Sharp. Stay Ahead.

Join our Telegram Channel for exclusive content, real insights,

engage with us and other members and get access to

insider updates, early news and top insights.

Join the Channel

Join the Channel

Benessere e autonomia degli studenti

Le linee guida pongono grande attenzione alla sicurezza psicologica, vietando funzionalità di IA che possano accentuare lo stress scolastico o alimentare una competizione malsana. I sistemi dovranno integrare protezioni contro design che creano dipendenza e contro l’eccessivo tempo trascorso davanti agli schermi.

Gli sviluppatori dovranno dimostrare come le proprie soluzioni supportino l’autonomia e il pensiero indipendente degli studenti.

“Queste tecnologie devono rafforzare la capacità critica, non generare dipendenza,”

ha spiegato Pietro Romano, commissario europeo per l’educazione digitale.

Il quadro prevede valutazioni regolari sull’impatto dell’IA su motivazione e autoefficacia degli studenti. Le scuole saranno tenute a monitorare e segnalare eventuali effetti negativi sul benessere, prevedendo modifiche tempestive ai sistemi se necessario.

La creazione del codice: un approccio collaborativo

Il processo di sviluppo del codice ha visto la partecipazione di una coalizione senza precedenti: insegnanti, aziende tech, psicologi dell’infanzia e rappresentanti degli studenti. Oltre 200 organizzazioni hanno contribuito durante un anno di consultazioni, assicurando pluralità di prospettive nel documento finale.

Il contributo diretto degli studenti è stato centrale, conducendo a tutele più robuste per l’autonomia e a controlli più severi sul tracciamento algoritmico dei percorsi scolastici.

I leader dell’industria tecnologica hanno collaborato attivamente alla definizione dei tempi di implementazione.

“Siamo impegnati nello sviluppo di strumenti che rispettino questi limiti etici stimolando l’innovazione educativa,”

ha affermato Sarah Chen, direttrice dell’Education presso TechEd Alliance.

Il ruolo dell’IA ripensato

Il codice introduce un cambiamento di paradigma nel modo in cui l’IA viene intesa a scuola. Non più autorità, ma strumento collaborativo al servizio della didattica condotta dagli insegnanti.

Questa nuova concezione promuove la creatività e il pensiero critico degli studenti. Le applicazioni di IA dovranno includere elementi che stimolino la messa in discussione delle raccomandazioni algoritmiche e rafforzino la capacità di problem solving autonomo.

Alla figura dell’insegnante è garantita una tutela esplicita contro la sostituzione da parte dell’intelligenza artificiale. Il codice stabilisce che l’IA deve arricchire, non automatizzare, la funzione pedagogica di base. L’intento è preservare l’essenza umana dell’istruzione sfruttando le opportunità offerte dalla tecnologia.

Per approfondire l’impatto dell’intelligenza artificiale sui processi cognitivi, inclusi apprendimento e plasticità cerebrale, consulta neuroplasticità e feedback intelligenti.

Verso uno standard globale

Il quadro normativo europeo ha già raccolto l’attenzione della comunità internazionale. Alcune istituzioni scolastiche di altri continenti stanno valutando l’adozione di linee guida analoghe.

UNESCO ha espresso apprezzamento per l’attenzione della normativa europea al benessere degli studenti, indicando che proprio questo equilibrio tra innovazione e vincoli etici potrebbe ispirare future raccomandazioni internazionali sull’IA nell’istruzione.

Numerose aziende del settore edtech attive a livello globale stanno già allineando le proprie roadmap di sviluppo agli standard europei, suggerendo che l’impatto del codice potrà estendersi ben oltre i confini dell’Unione.

Per una panoramica sulle tecnologie adattive che favoriscono l’inclusione di studenti con bisogni specifici, è utile approfondire le soluzioni AI per studenti neurodivergenti.

Progetti pilota e tempi di implementazione

I programmi pilota avranno inizio in scuole selezionate di cinque Stati membri il prossimo semestre. Questa sperimentazione consentirà alle autorità di valutare l’efficacia dei principi e di apportare eventuali modifiche.

La tabella di marcia prevede un’implementazione graduale. Scuole e fornitori tecnologici avranno 18 mesi di tempo per conformarsi pienamente. Sono previsti team di assistenza tecnica e fondi dedicati alla formazione dei docenti.

Stay Sharp. Stay Ahead.

Join our Telegram Channel for exclusive content, real insights,

engage with us and other members and get access to

insider updates, early news and top insights.

Join the Channel

Join the Channel

Le autorità regionali istituiranno comitati di monitoraggio incaricati di verificare i progressi e intervenire in caso di criticità. I rapporti saranno inviati trimestralmente al Consiglio europeo dell’istruzione per garantire trasparenza nel passaggio al nuovo scenario.

Conclusione

Il nuovo codice etico europeo sull’IA ridefinisce la tecnologia in aula come alleato e non come giudice, mettendo benessere degli studenti e ruolo insostituibile dei docenti al centro della trasformazione digitale. Questo quadro normativo innesta l’innovazione entro confini etici e rappresenta una svolta culturale dalle potenziali ripercussioni globali. Da tenere d’occhio i progetti pilota in cinque Paesi UE al via il prossimo semestre e i rapporti trimestrali al Consiglio europeo dell’istruzione che accompagneranno l’implementazione.

Per esplorare le radici filosofiche che legano linguaggio, intelligenza artificiale e apprendimento umano, puoi leggere AI origin philosophy.

Inoltre, chi desidera comprendere le sfide etiche e regolamentari di un utilizzo responsabile dell’intelligenza artificiale in Europa potrà approfondire la normativa europea sull’IA.

Leave a Reply